Sachin Tendulkar Deepfake: मुंबई पुलिस के एक अधिकारी ने शुक्रवार को कहा कि प्रसिद्ध क्रिकेटर सचिन तेंदुलकर की अनुमति के बिना औषधीय वस्तुओं के विज्ञापन के लिए उनके नाम, फोटो और आवाज का इस्तेमाल करने के लिए अज्ञात व्यक्तियों के खिलाफ प्राथमिकी दर्ज की गई है।

उनके अनुसार, तेंदुलकर के सहयोगी ने गुरुवार को पश्चिम क्षेत्र साइबर पुलिस स्टेशन में शिकायत दर्ज कराई। शिकायतकर्ता ने कहा कि उसने एक दवा कंपनी के वेब विज्ञापन देखे, जिसमें दावा किया गया था कि मास्टर बल्लेबाज उनकी फार्मास्युटिकल लाइन का समर्थन करता है।

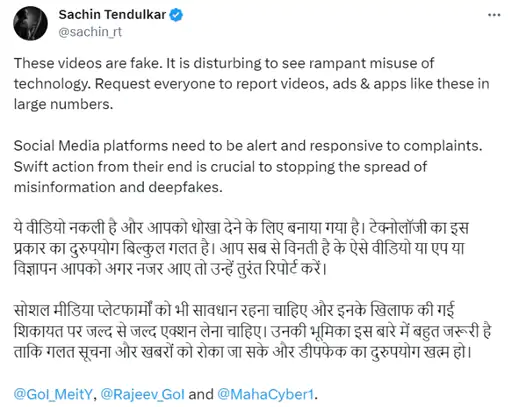

These videos are fake. It is disturbing to see rampant misuse of technology. Request everyone to report videos, ads & apps like these in large numbers.

Social Media platforms need to be alert and responsive to complaints. Swift action from their end is crucial to stopping the… pic.twitter.com/4MwXthxSOM

— Sachin Tendulkar (@sachin_rt) January 15, 2024

वीडियो में सचिन की बेटी का भी जिक्र(Sachin Tendulkar Deepfake)

इसमें फेक वीडियो में वे ये कहते नजर आते हैं कि उनकी बेटी सारा इस गेम से रोजाना बड़ी मात्रा में पैसा निकालती हैं। वे लोगों को बताते हैं कि मुझे आश्चर्य होता है कि अब अच्छा पैसा कमाना कितना आसान हो गया है।

नवंबर में रश्मिका मंदाना का Deepfake वीडियो वायरल हुआ था

पिछले साल नवंबर में रश्मिका मंदाना(Rashmika Mandanna) का एक डीपफेक वीडियो सोशल मीडिया पर वायरल हआ था, जिसमें AI टेक्नोलॉजी से एक इन्फ्लूएंसर के चेहरे पर बड़ी सफाई से रश्मिका का चेहरा मोर्फ किया गया था। सोशल मीडिया पर हजारों लोगों ने रश्मिका के इस फेक वीडियो को असली समझ लिया क्योंकि उसमें दिख रहे एक्सप्रेशन बिल्कुल रियल लग रहे थे।

Also Read: Rashmika Mandanna का यह रूप देखकर हो जाएंगे हैरान, जान ले पूरी बात

Deepfake होता क्या है और कैसे बनाया जाता है?

डीपफेक शब्द पहली बार 2017 में यूज किया गया था। तब अमेरिका के सोशल न्यूज एग्रीगेटर Reddit पर डीपफेक आईडी से कई सेलिब्रिटीज के वीडियो पोस्ट किए गए थे। इसमें एक्ट्रेस एमा वॉटसन, गैल गैडोट, स्कारलेट जोहानसन के कई पोर्न वीडियो थे।

किसी रियल वीडियो, फोटो या ऑडियो में दूसरे के चेहरे, आवाज और एक्सप्रेशन को फिट कर देने को डीपफेक नाम दिया गया है। ये इतनी सफाई से होता है कि कोई भी यकीन कर ले। इसमें फेक भी असली जैसा लगता है।

इसमें मशीन लर्निंग और आर्टिफिशियल इंटेलिजेंस का सहारा लिया जाता है। इसमें वीडियो और ऑडियो को टेक्नोलॉजी और सॉफ्टवेयर की मदद से बनाया जाता है।

AI और साइबर एक्सपर्ट पुनीत पांडे बताते हैं कि अब रेडी टु यूज टेक्नोलॉजी और पैकेज उपलब्ध है। अब इसे कोई भी उपयोग कर सकता है। वर्तमान टेक्नोलॉजी में अब आवाज भी इम्प्रूव हो गई है। इसमें वॉयस क्लोनिंग बेहद खतरनाक हो गई है।

Also Read: Alia Bhatt ने पहनी शादी की साड़ी, इस पर सुहाना खान ने कर दिया कमेंट